GPUサーバーとは何なのか。知っておくべき知識と最新情報

GPUサーバーとは 〜役割と本質〜

※引用:「NVIDIA Data Center GPUs|NVIDIA」

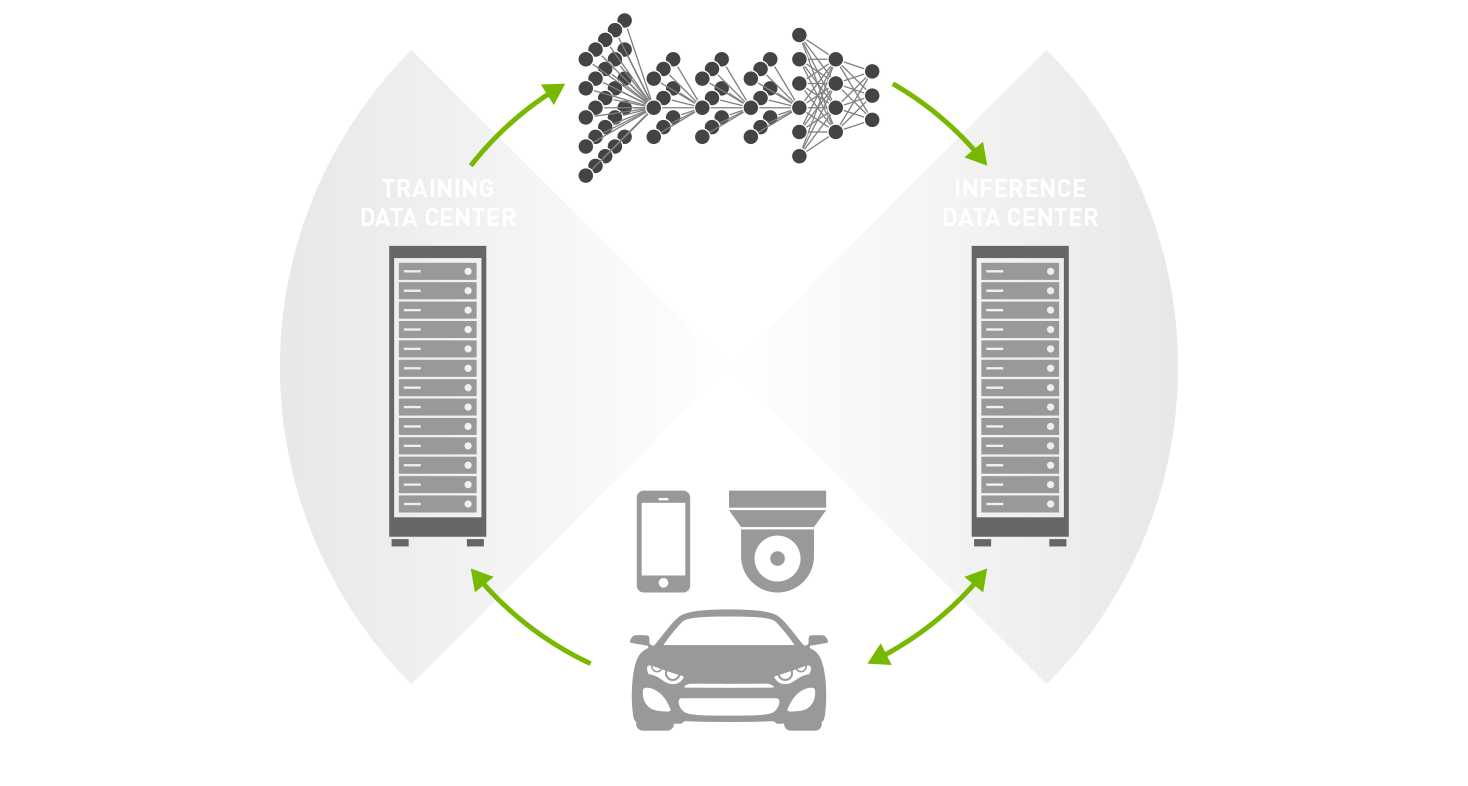

GPUサーバーとは、並列演算処理に特化したGPUを核に据えることで、従来の汎用サーバーの限界を突破した超高性能な計算基盤のこと。かつてGPUサーバーは主に「モデルの学習」のために利用されていたが、現在は訓練済みのAIを動かし、リアルタイムで応答を返す「推論(インファレンス)」や、自律的に思考し行動する「エージェント型AI」の実行基盤としての需要が急増している。さらに、4ビット浮動小数点(FP4)といった新しい数値精度の導入により、これまで以上に高速かつ効率的なAI運用が可能となった。これにより、GPUサーバーは単なるIT機器の枠を超え、国家の競争力を左右する「ソブリンAI(主権的AI)」の担い手、あるいは企業の生産性を根底から変革するための、最も希少価値の高い戦略物資としての地位を確立しているのである。

さらに、GPUサーバーの本質は、単なる「速いコンピュータ」ではなく、データと電力を人工知能へと変換する「AI」の心臓部としての役割にある。NVIDIAのCEOジェンスン・フアン氏が提唱するように、現代のコンピューティングは、個別の処理を行う従来の形態から、数千から数万のGPUが巨大な一つのユニットとして機能する「データセンター・スケール」へと完全に移行している。

CPUとGPUは何が違うのか?

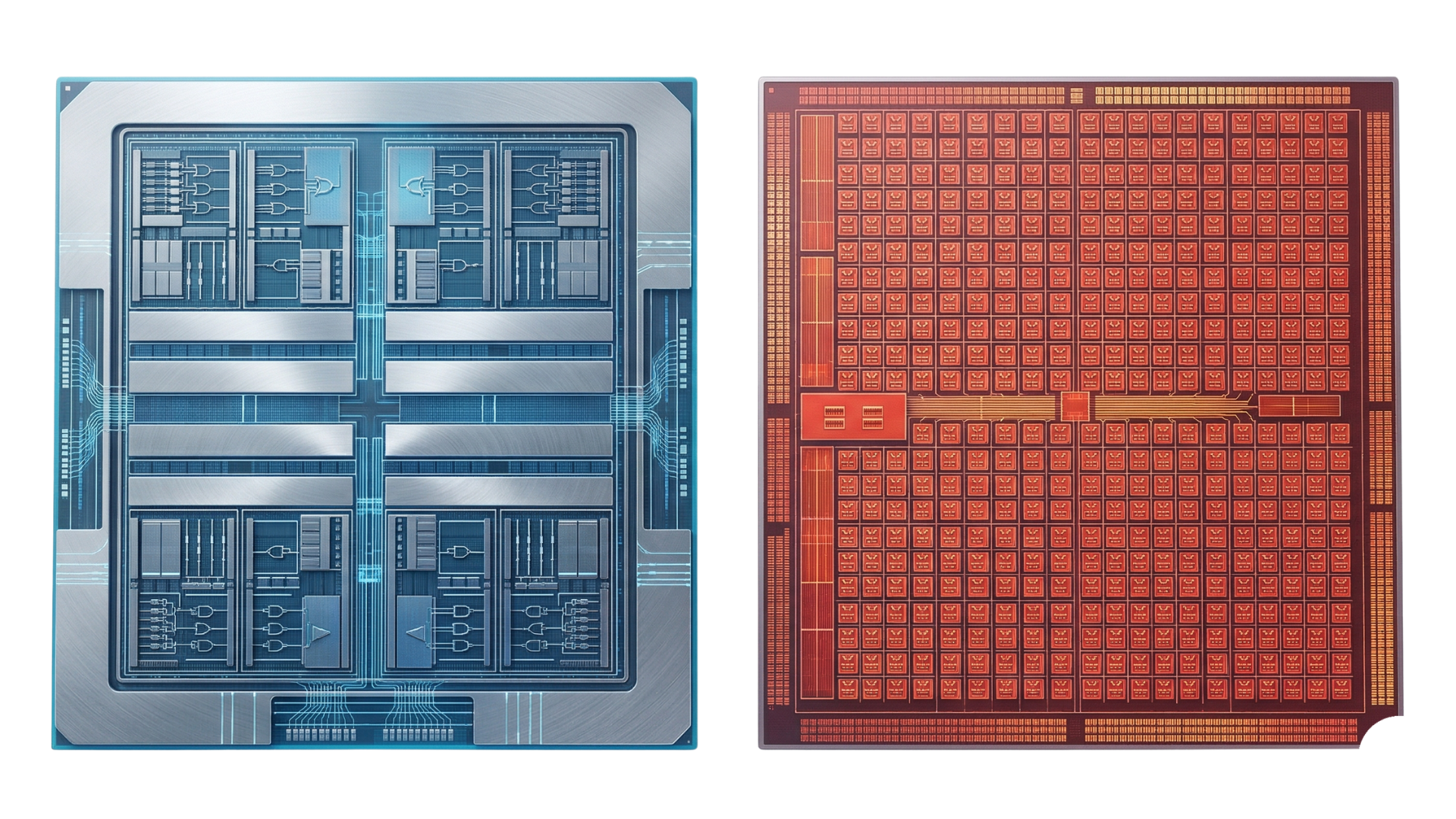

一般的なサーバーが搭載するCPUが「少数(数十個)の非常に強力なコア」を持ち、複雑な命令を順番に、かつ確実に処理する「直列処理」を得意とするのに対し、GPUサーバーは「数千から数万個のシンプルなコア」を搭載している。この構造により、数百万もの計算を同時に実行する「並列処理」が可能となる。例えば、生成AIの基幹技術である大規模言語モデル(LLM)の学習においては、膨大な行列演算を一斉に処理する必要があり、この点においてGPUサーバーはCPU単独の環境と比較して数百倍から数千倍という劇的な速度差を生み出す。

GPUサーバーが日本で急速に広まっている背景

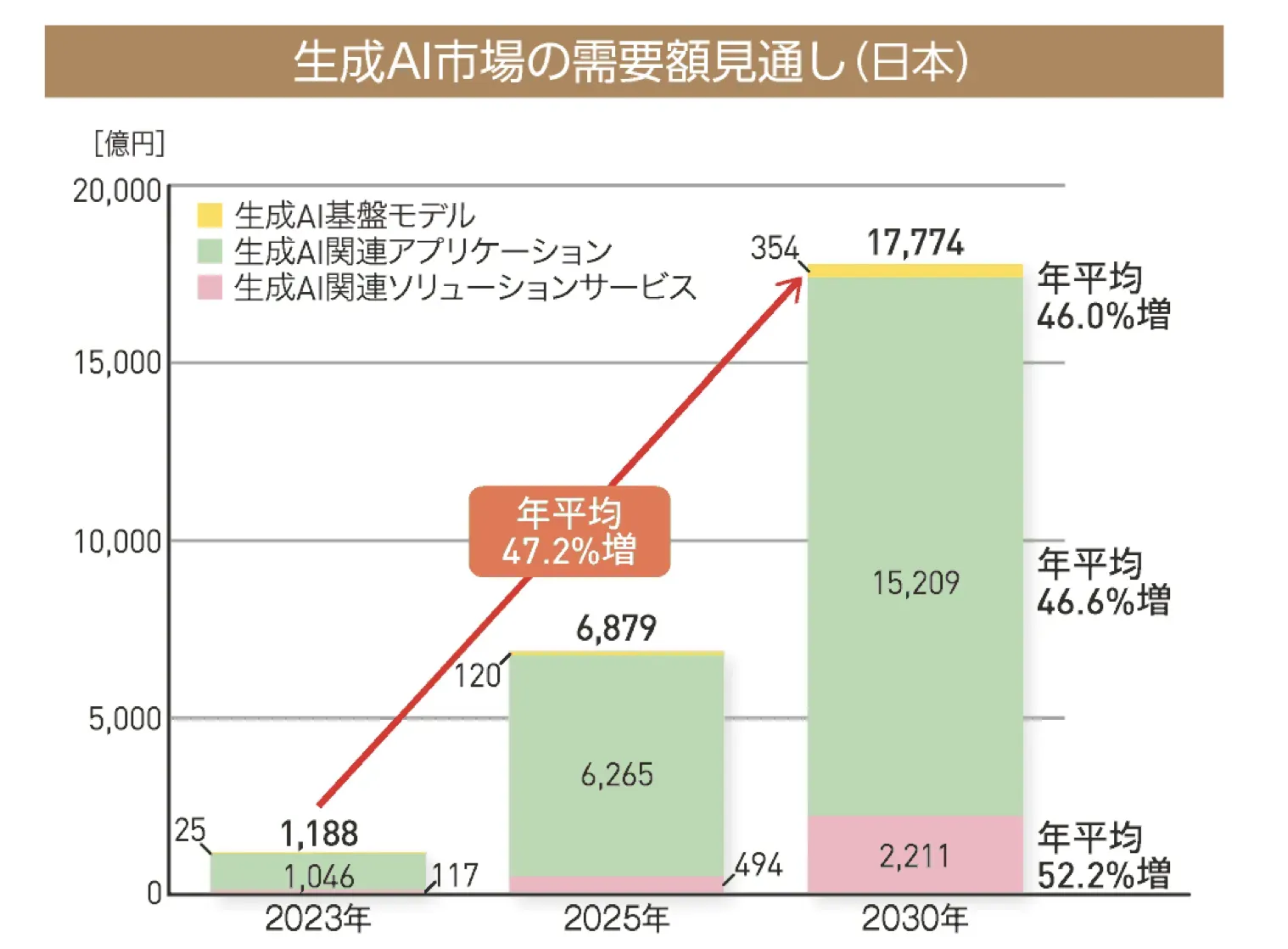

※引用:「国内生成AI市場の需要額グラフ|AI総合研究所」

日本におけるGPUサーバーの普及を後押ししている最大の要因は、経済産業省が主導する「計算資源の確保」に対する強力な支援策である。生成AIの急速な発展を受け、日本政府は特定の外国企業やクラウドベンダーに計算基盤を依存しすぎるリスクを深刻に捉えている。これに対し、さくらインターネットやソフトバンク、NTTといった国内企業に対し、数千億円規模の補助金を交付し、最新鋭のNVIDIA製GPU(Blackwell等)を搭載した大規模クラスタの国内構築を加速させている。これは「ソブリンAI(主権的AI)」と呼ばれる概念に基づくものであり、日本独自の文化や商習慣、言語特性を反映したAIモデルを、日本国内のデータセンターで、日本独自の管理下に置く構想が主軸にある。

電力コストと熱管理技術に課題

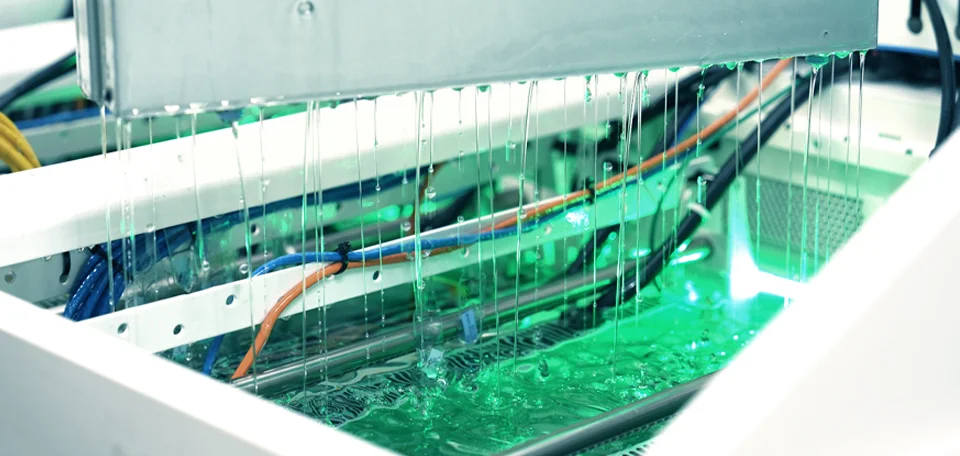

※引用:「データセンターの冷却用消費電力を94%削減する「地球にやさしい」にこだわった液浸冷却システム|KDDIトビラ」

インフラ面における日本特有の適応策にも注目が集まっている。GPUサーバーは莫大な電力を消費し、極めて高い熱を発生させるが、電力コストが高く湿潤な気候の日本において、これを効率的に運用することは容易ではない。そのため、北海道のような寒冷地へのデータセンター移設や、サーバーを特殊な液体に沈める「液浸冷却」技術、あるいは冷媒をチップに直接循環させる「液体冷却」システムの導入が急速に進んでいる。これらの高度な熱管理技術は、日本の精密なエンジニアリング能力が発揮される領域であり、GPUのポテンシャルを最大限に引き出すための重要な要素となっている。

GPUサーバーの未来展望

かつては一握りの巨大クラウドベンダーが計算資源を独占していたが、現在は国家や特定企業が自前のデータを守りつつ独自の知能を生成するため、自国・社内に専用のGPUサーバー群を構築する動きが世界的に加速している。これにより、特定の汎用チップだけでなく、特定のタスクに特化したLPU(言語処理ユニット)や、推論専用のカスタムASICを搭載したサーバーが混在する、多様なハードウェアエコシステムが形成される。2027年までにAI推論市場は1兆ドル規模に達すると予測されており、この膨大な需要を支えるために、エッジ側でリアルタイムに稼働する「小型・高効率GPUサーバー」の需要も爆発的に増加する見通しである。

未来のGPUサーバーは、単なる「部品」の集合体ではなく、光ネットワーク、高度な熱力学、そして独自のAI半導体が高度に融合した「自律的な知能生産拠点」へと変貌を遂げることが予測されている。